在一家跨地区团队工作了一段时间后,我发现一个挺真实的痛点:会议语言有时候是粤语。

虽然大家也能切换普通话或英语,但很多时候讨论进入状态之后,自然就会变成粤语交流。其实我自己最近也刚好在学粤语,但如果你不是长期在粤语环境里,在工作场景下会遇到一种很微妙的情况:

不是完全听不懂,但经常只能听懂七八成。

特别是遇到一些香港本地表达、粤语里夹杂英文、多人同时快速讨论的时候。结果就是:会议能跟上大概意思,但细节容易漏掉。有时候大家已经开始讨论下一个问题了,我还在脑子里 compile 上一句到底说了什么。

久而久之觉得挺影响沟通效率,所以后来我就做了一个自己用的小工具:

把电脑里播放的粤语语音,实时变成中文字幕。

当然不止是粤语翻粤,英语、日语、韩语等都可以。

网站:https://fanyueai.com/

解决的其实就是一个很简单的场景

我做这个工具最初只有一个目标:开会的时候能实时看到字幕。

不管是 Zoom 、Google Meet 、Teams 还是网页版会议,只要电脑里有粤语语音,它就会:

[ol]

[/ol]

当有人语速很快的时候,看一眼字幕基本就能跟上内容。因为是系统级音频监听,所以平时用来看港区 YouTube 、听粤语播客,或者看没字幕的生肉视频也都能顺带用上。

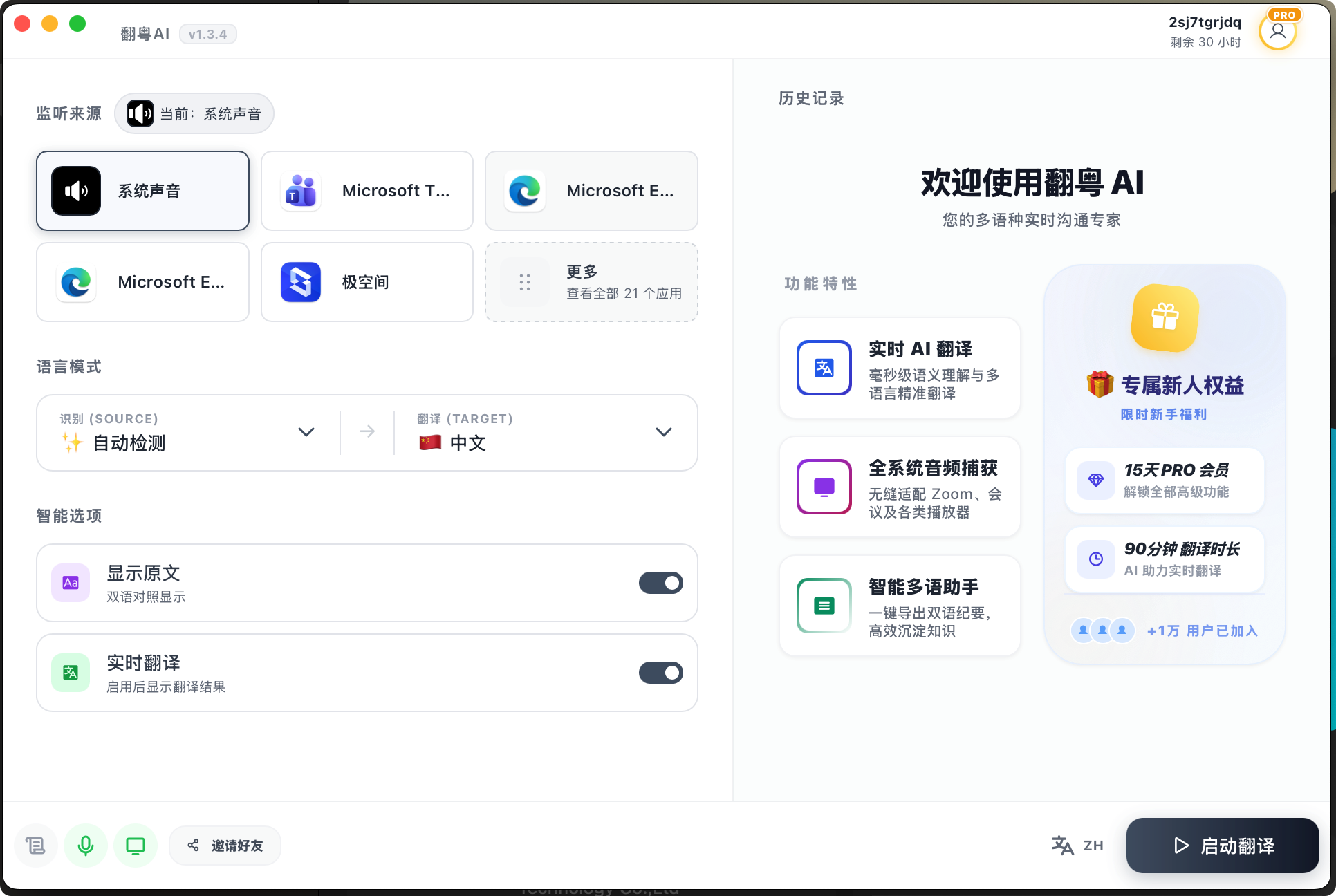

主界面

实时字幕界面

聊聊技术演进和踩坑

一开始我也想过做成某个会议软件的插件,但大家用的软件太杂了,最后决定直接做系统级监听。

客户端我个人比较反感那种动不动就吃掉几个 GB 内存的 Electron 巨兽,所以:

关于核心的翻译延迟问题,其实经历过一次重构:

一开始的 V1 版本,我图省事直接接了阿里云的自动识别与翻译 API 。调用一个接口就能出结果,开发确实快,但效果很感人:机器味重、识别不准,而且延迟太高,开会用起来有明显的割裂感。

后来痛定思痛改了架构。最近刚好发现 Google 新出了 gemini-3.1-flash-lite 模型,测试了一下发现用来做实时翻译简直是神器:速度极快,翻译的人话味道很浓,最关键的是支持自定义提示词(可以喂给它一些团队开会常用的 IT 缩写和黑话)。

所以现在的版本改成了:实时语音识别 + 实时流式调用大模型 API 进行翻译。目前把整体的延迟压在了开会完全可接受的范围内。

如果你刚好有类似场景

目前打包了 macOS 和 Windows 版本( Windows 没测太多老系统,目前 Win10 及以上可以正常跑)。

如果你也是在香港工作的内地开发者,或者有远程和港区团队合作的需求,可以试试这个工具:

[https://fanyueai.com/?ref=BRSLH8JQ](通过邀请码注册即赠 120 分钟时长。点击体验: https://fanyueai.com/?ref=BRSLH8JQ)

给刚注册的新用户默认塞了 15 天体验和 90 分钟的翻译时长,基本足够大家开几次会,或者看个视频体验一下效果了。

我自己也是一边用一边慢慢迭代,如果大家体验后觉得有什么 Bug ,或者在技术实现上(特别是跨平台音频流处理这块)有更好的思路,欢迎在帖子里吐槽交流,我下班后去修。